Czym jest audyt SEO i dlaczego Twoja strona go potrzebuje?

Audyt SEO to systematyczna analiza strony internetowej pod kątem technicznym, contentowym i strategicznym. Jego cel jest prosty: znaleźć wszystko co blokuje widoczność w Google i ułożyć plan naprawy w kolejności od największego wpływu. W praktyce każdy skuteczny audyt SEO odpowiada na trzy pytania. Czy roboty Google mogą poprawnie zaindeksować witrynę. Czy treści odpowiadają na intencje użytkowników. Czy strona działa wystarczająco szybko na urządzeniach mobilnych. Bez tej diagnozy optymalizacja strony przypomina leczenie bez badań krwi. Wdrażasz zmiany na ślepo i nie wiesz które z nich faktycznie przesunęły pozycje. Z mojego doświadczenia wynika że sam audyt techniczny potrafi ujawnić problemy które kosztują witrynę 30-40% potencjalnego ruchu organicznego. Dlatego traktuję go jako pierwszy etap każdej współpracy, zanim w ogóle rozmawiam o pozycjonowaniu stron czy strategii słów kluczowych.

Jakie rodzaje audytów stron internetowych wyróżniamy?

Nie każda strona wymaga tego samego zakresu analizy. Sklep internetowy na WooCommerce z 2000 produktów potrzebuje zupełnie innego podejścia niż strona wizytówkowa na 5 podstron. Dlatego przed rozpoczęciem pracy dzielę audyt na cztery odrębne obszary i dla każdego projektu ustalam które z nich są priorytetowe. Czasem klient przychodzi z problemem szybkości a po analizie okazuje się że prawdziwy bloker to struktura witryny która uniemożliwia poprawne crawlowanie.

Audyt techniczny SEO

Zaczynam od niego zawsze, bez wyjątków. Audyt techniczny obejmuje wszystko co wpływa na to jak Googlebot widzi i przetwarza witrynę. Sprawdzam indeksację w Google Search Console, analizuję plik robots.txt, weryfikuję mapę strony XML i przechodzę przez raport Core Web Vitals. Do tego dochodzi analiza kodu strony: przekierowania 301, błędy 404, kanoniczne adresy URL, dane strukturalne i poprawność wdrożenia hreflang przy wersjach językowych. Jeśli na tym etapie znajdę zablokowaną indeksację lub masowe duplikaty to reszta audytu schodzi na drugi plan dopóki te problemy nie zostaną naprawione.

Audyt treści i słów kluczowych

Technika może być bezbłędna a strona i tak nie zbiera ruchu. Powód jest prawie zawsze ten sam: treści nie odpowiadają na to czego szukają użytkownicy. W audycie contentu analizuję nasycenie frazami kluczowymi, sprawdzam meta title i meta description na każdej podstronie, szukam kanibalizacji słów kluczowych i identyfikuję zduplikowane treści. Równolegle robię analizę i dobieram słówa kluczowe w Senuto żeby sprawdzić czy strona w ogóle targetuje frazy z realnym potencjałem wyszukiwań. Najczęstszy problem jaki znajduję to podstrony które konkurują między sobą o tę samą frazę i w efekcie żadna z nich nie wchodzi do top 10.

Audyt UX i użyteczności

Pozycja w Google to dopiero połowa sukcesu. Użytkownik który trafia na stronę i nie może znaleźć tego czego szuka odbija się w 3 sekundy. Audyt UX weryfikuję przez konkretne metryki z Google Analytics 4: współczynnik odrzuceń, średni czas sesji, ścieżki konwersji i zachowanie na urządzeniach mobilnych. Sprawdzam czy nawigacja i menu strony internetowej są intuicyjne, czy formularze kontaktowe działają poprawnie i czy strona jest w pełni responsywna. Przy sklepach internetowych dochodzi analiza procesu zakupowego i porzuconych koszyków.

Audyt bezpieczeństwa strony

Ten rodzaj audytu pomijają prawie wszystkie poradniki w sieci a Google od lat traktuje bezpieczeństwo jako sygnał rankingowy. Sprawdzam poprawność certyfikatu SSL, nagłówki bezpieczeństwa HTTP, aktualność wersji CMS i wtyczek oraz odporność na podstawowe wektory ataku. Na WordPressie regularnie znajduję nieaktualizowane pluginy z znanymi podatnościami które Google może oznaczyć jako potencjalne zagrożenie. Jeśli witryna padła ofiarą malware to usunięcie wirusa i zabezpieczenie musi nastąpić przed jakąkolwiek pracą nad SEO.

Jakie narzędzia przygotować przed rozpoczęciem audytu?

Zanim otworzę pierwszy raport potrzebuję dostępu do konkretnego zestawu narzędzi. Nie chodzi o to żeby mieć ich jak najwięcej. Chodzi o to żeby każde z nich pokrywało inny obszar audytu bez dublowania funkcji. W praktyce do przeprowadzenia kompleksowej analizy strony internetowej wystarczą trzy darmowe narzędzia od Google i dwa lub trzy płatne. Kluczowe jest to żeby specjalista miał bezpośredni dostęp do kont a nie screenshoty od klienta. Screeny nie pokazują trendów, nie pozwalają filtrować danych i nie dają kontekstu który jest niezbędny przy interpretacji wyników.

Darmowe narzędzia: Google Search Console, Analytics i PageSpeed Insights

Google Search Console to absolutna podstawa każdego audytu SEO. Bez niego nie sprawdzę stanu indeksacji, nie zobaczę na jakie frazy strona się wyświetla ani nie zidentyfikuję błędów crawlowania. Google Analytics 4 daje mi dane o zachowaniu użytkowników: skąd przychodzą, jak długo zostają, które podstrony konwertują a które generują odbicia. Trzecie narzędzie to PageSpeed Insights, które mierzy Core Web Vitals i wskazuje konkretne elementy spowalniające ładowanie strony. Do tego zestawu dodaję Google Keyword Planner przy analizie słów kluczowych i Google Tag Manager do weryfikacji poprawności wdrożonych tagów. Cały ten zestaw kosztuje zero złotych a pokrywa 60-70% potrzeb podstawowego audytu.

Płatne narzędzia: Screaming Frog, Senuto i SEMrush

Darmowe narzędzia SEO mają swoje granice i trafiasz na nie szybko. Screaming Frog to crawler który skanuje witrynę dokładnie tak jak robi to Googlebot. Pokazuje mi pełny obraz: zduplikowane meta tagi, brakujące nagłówki H1, łańcuchy przekierowań 301, osierocone podstrony i wewnętrzne linki prowadzące do błędów 404. Darmowa wersja pozwala przeskanować 500 adresów URL. Przy większych serwisach licencja jest konieczna. Senuto używam do analizy widoczności na polskim rynku: sprawdzam pozycje fraz kluczowych, monitoruję zmiany w top 10 i porównuję wyniki z konkurencją. SEMrush uzupełnia ten zestaw o analizę linków zwrotnych i audyt techniczny w chmurze który mogę udostępnić klientowi bez instalowania czegokolwiek. Przy darmowych narzędziach SEO warto zacząć naukę, natomiast profesjonalny audyt bez płatnych rozwiązań będzie niepełny.

Audyt techniczny — indeksacja, szybkość i Core Web Vitals

Techniczne SEO decyduje o tym czy Google w ogóle zobaczy treści na stronie. Miałem przypadki gdzie klient inwestował tysiące złotych w content marketing a połowa podstron miała ustawiony tag noindex po migracji sprzed roku. Dlatego audyt technicznego SEO zawsze robię jako pierwszy i dopiero po naprawieniu krytycznych błędów przechodzę do analizy treści czy linkowania. W Screaming Frog uruchamiam pełny crawl witryny i eksportuję dane do arkusza. Potem sprawdzam je równolegle z raportami z Google Search Console. Te dwa źródła uzupełniają się nawzajem i łapią problemy których jedno z nich nie widzi.

Robots.txt, sitemap.xml i błędy indeksacji

Pierwszą rzeczą którą otwieram jest plik robots.txt pod adresem domena.pl/robots.txt. Sprawdzam czy nie blokuje dostępu do istotnych sekcji serwisu i czy wskazuje prawidłową lokalizację mapy witryny. Potem przechodzę do sitemap.xml i weryfikuję czy zawiera tylko adresy zwracające kod 200. Zdarza się że mapa witryny prowadzi do stron z przekierowaniem 301 albo do błędów 404 co wysyła Googlebotowi sprzeczne sygnały. W Google Search Console otwieram raport Strony i analizuję zakładkę Dlaczego strony nie są indeksowane. Najczęstsze problemy które znajduję to strony zablokowane przez robots.txt, duplikaty bez tagu canonical i podstrony z kodem soft 404. Każdy z tych błędów marnuje budżet crawlowania i obniża efektywność indeksacji całego serwisu.

Szybkość ładowania strony i wydajność mobilna

Otwieram PageSpeed Insights, wklejam adres strony głównej i od razu patrzę na dane terenowe a nie laboratoryjne. Dane terenowe pochodzą od prawdziwych użytkowników Chrome i to na ich podstawie Google ocenia Core Web Vitals. Trzy metryki które muszą przejść: LCP poniżej 2.5 sekundy, INP poniżej 200 milisekund i CLS poniżej 0.1. Jeśli którakolwiek świeci na czerwono to priorytet naprawy jest wysoki. Na WordPressie najczęstsze przyczyny wolnego ładowania to niezoptymalizowane obrazy, zbyt wiele wtyczek ładujących skrypty JS w nagłówku i brak cache po stronie serwera. Przy urządzeniach mobilnych dodatkowo sprawdzam czy strona przechodzi test responsywności strony i czy elementy dotykowe mają wystarczające odstępy. Od marca 2025 Google używa wyłącznie mobile-first indexing więc wydajność mobilna to nie opcja a warunek konieczny.

Audyt treści — słowa kluczowe, meta tagi i struktura nagłówków

Strona może być technicznie perfekcyjna i nadal nie zbierać ruchu organicznego. Powód jest zazwyczaj ten sam: treści nie trafiają w to czego szukają ludzie albo są tak słabo zoptymalizowane że Google nie wie której podstronie przypisać daną frazę. Audyt treści to moment w którym sprawdzam czy każda podstrona ma jasno przypisane słowo kluczowe, poprawne meta tagi i logiczną hierarchię nagłówków. W Screaming Frog eksportuję listę wszystkich tytułów, opisów i H1 do arkusza i szukam powtórzeń, braków oraz podstron które konkurują ze sobą o tę samą frazę. Ta lista staje się potem fundamentem dla pisania treści SEO i planu publikacji nowych materiałów.

Analiza słów kluczowych i intencji użytkowników

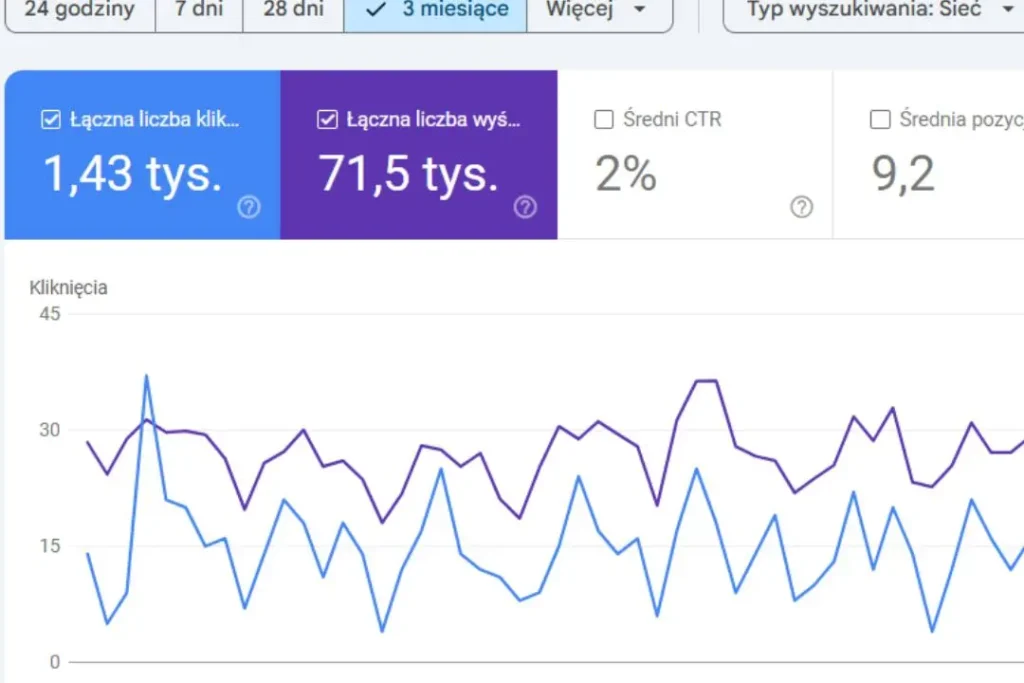

Otwieram Senuto, wpisuję domenę klienta i sprawdzam na ile fraz strona jest widoczna w top 10, top 50 i poza top 50. Same liczby to jednak dopiero początek. Dla każdej kluczowej podstrony weryfikuję czy przypisana fraza odpowiada faktycznej intencji wyszukiwania. Strona usługowa nie powinna targetować frazy informacyjnej a wpis blogowy nie powinien walczyć o frazę transakcyjną. W praktyce dobór słów kluczowych polega na zestawieniu trzech rzeczy: potencjału wyszukiwań, poziomu konkurencji i dopasowania do tego co podstrona faktycznie oferuje. Sprawdzam też SERP ręcznie bo Senuto pokaże mi pozycje ale nie pokaże czy Google wyświetla na daną frazę wyniki zakupowe, mapy lokalne czy featured snippet. Ten kontekst zmienia całą strategię optymalizacji treści.

Meta title, meta description i zduplikowane treści

W wyeksportowanym raporcie ze Screaming Frog filtruję najpierw podstrony z brakującym meta title lub z tytułem dłuższym niż 60 znaków. Potem to samo robię z meta description sprawdzając czy mieści się w 155 znakach i czy zawiera frazę kluczową przypisaną do danej podstrony. Zduplikowane tytuły to sygnał alarmowy bo oznaczają że dwie lub więcej stron próbuje rankować na to samo zapytanie. Osobny problem stanowi thin content czyli podstrony z kilkudziesięcioma słowami które nie wnoszą żadnej wartości. Google od aktualizacji Helpful Content traktuje takie strony jako obciążenie dla całego serwisu a nie tylko jako słabe jednostki. Przy większych witrynach sprawdzam też duplikację treści wewnętrzną przez porównanie podobieństwa tekstów w Siteliner. Zewnętrzną duplikację weryfikuję losowo przez Copyscape szczególnie gdy klient korzystał wcześniej z taniego copywritingu.

Audyt struktury strony i linkowania wewnętrznego

Struktura witryny decyduje o tym jak Googlebot rozumie hierarchię podstron i rozdziela między nie moc linkową. Podczas audytu SEO otwieram wizualizację crawlu w Screaming Frog i sprawdzam głębokość kliknięć. Każda podstrona istotna biznesowo powinna być dostępna w maksymalnie 3 kliknięciach od strony głównej. Jeśli nie jest to pierwsza rekomendacja dotyczy przebudowy architektury serwisu. Eksportuję wszystkie linki wewnętrzne i analizuję rozkład anchor textów. Sprawdzam czy anchory zawierają frazy kluczowe przypisane do stron docelowych czy są generyczne typu kliknij tutaj. Weryfikuję też osierocone podstrony do których nie prowadzi żaden link wewnętrzny. Na koniec sprawdzam nawigację i breadcrumbs z danymi strukturalnymi BreadcrumbList.

Jak znaleźć osierocone podstrony w Screaming Frog:

- Uruchom crawl domeny i poczekaj na zakończenie skanowania.

- Kliknij Crawl Analysis i w konfiguracji podłącz sitemap.xml oraz Google Search Console jako źródła dodatkowe.

- Uruchom ponownie analizę. Program porówna adresy z crawlu ze źródłami zewnętrznymi.

- W lewym panelu otwórz zakładkę Orphan Pages z listą podstron bez linków wewnętrznych.

- Wyeksportuj listę i przy każdym adresie zdecyduj: podlinkować z istniejących treści, dodać do mapy witryny albo usunąć.

Jak sprawdzić profil linków zwrotnych i anchor texty?

Profil linków to jeden z trzech najsilniejszych czynników rankingowych i jednocześnie obszar w którym najłatwiej o karę algorytmiczną. Otwieram Ahrefs, wpisuję domenę i zaczynam od trzech liczb: łączna liczba domen linkujących, stosunek dofollow do nofollow oraz tempo przyrostu nowych backlinków. Potem przechodzę do rozkładu anchor textów. Zdrowy profil linków zewnętrznych to dominacja anchorów brandowych z niewielkim udziałem exact match. Jeśli 40% odnośników ma anchor dokładnie dopasowany do frazy kluczowej to ryzyko filtra jest realne. Sprawdzam też jakość domen linkujących i oznaczam toksyczne linki do disavow w Google Search Console. Na koniec porównuję profil z trzema najsilniejszymi konkurentami w ramach analizy widoczności.

Jak wykonać audyt profilu linków krok po kroku:

- Otwórz Ahrefs Site Explorer i wpisz domenę. W zakładce Overview odczytaj Referring Domains i Domain Rating.

- Przejdź do Anchors i wyeksportuj pełną listę. Pogrupuj anchory na brandowe, exact match, partial match i generyczne.

- W zakładce Referring Domains posortuj po DR od najniższego. Domeny z DR poniżej 10 i bez realnego ruchu oznacz jako podejrzane.

- Otwórz zakładkę New/Lost Backlinks i sprawdź czy przyrost jest naturalny czy występują nagłe skoki.

- Linki z farm, katalogów i PBN-ów dodaj do pliku disavow i prześlij przez Google Search Console.

Analiza konkurencji jako element audytu SEO

Audyt SEO bez kontekstu konkurencyjnego to ocenianie własnego wyniku bez znajomości rezultatów rywali. W Senuto wpisuję domeny trzech głównych konkurentów i porównuję widoczność na wspólnych frazach kluczowych. Szukam zapytań na których konkurencja rankuje a klient nie istnieje. To jest content gap który zamykam dedykowanymi podstronami. Potem w Ahrefs sprawdzam skąd rywale pozyskują backlinki i analizuję ich strukturę witryny w Screaming Frog. Często przewaga lidera nie leży w lepszych treściach ale w przemyślanej architekturze i silniejszym linkowaniu wewnętrznym.

Jak przeprowadzić analizę konkurencji w 5 krokach:

- W Senuto otwórz raport Analiza widoczności i wpisz swoją domenę. System automatycznie wskaże głównych konkurentów organicznych.

- Wybierz trzech rywali z największą liczbą wspólnych fraz i przejdź do porównania. Wyeksportuj listę słów kluczowych na których konkurent jest w top 10 a Twoja strona poza top 50.

- W Ahrefs otwórz Content Gap. Wpisz domeny rywali i swoją. Narzędzie pokaże frazy na które rankują wszyscy konkurenci ale nie Ty.

- Sprawdź profil linków każdego rywala. Zanotuj domeny z których pozyskują odnośniki i oceń które źródła są możliwe do powtórzenia.

- Wyniki zbierz w arkuszu z trzema kolumnami: fraza do zagospodarowania, podstrona do utworzenia, źródło linków do pozyskania. To staje się planem działań SEO na kolejne miesiące.

Czy audyt SEO dla sklepu internetowego się różni od audytu strony?

Fundament jest ten sam ale sklep internetowy generuje problemy których zwykła strona wizytówkowa po prostu nie ma. Przy e-commerce audytuję tysiące podstron produktowych, dziesiątki kategorii i filtrów które potrafią tworzyć setki zduplikowanych adresów URL. Każdy filtr cenowy, kolorystyczny czy rozmiarowy może wygenerować osobny URL indeksowany przez Google. Bez poprawnej konfiguracji tagów canonical i reguł w robots.txt budżet crawlowania marnuje się na strony zerowej wartości. Sprawdzam też dane strukturalne Product i Offer bo to one decydują czy w wynikach wyszukiwania pojawią się cena, dostępność i oceny gwiazdkowe. Osobny punkt to analiza stron z parametrami sortowania i paginacji. W platformach e-commerce typu WooCommerce czy PrestaShop domyślne ustawienia prawie zawsze wymagają korekty. Audytuję również ścieżkę zakupową pod kątem UX: czas ładowania karty produktu, proces dodawania do koszyka i checkout. Porzucone koszyki na poziomie 70% to sygnał że problem leży nie w widoczności strony ale w doświadczeniu użytkownika po kliknięciu.

Błędy 404, przekierowania 301 i dane strukturalne

Te trzy elementy sprawdzam w każdym audycie technicznym niezależnie od wielkości serwisu. Błędy 404 oznaczają że użytkownik i Googlebot trafiają na stronę która nie istnieje. Kilka takich błędów to norma. Kilkadziesiąt to problem który rozprasza budżet crawlowania i psuje doświadczenie użytkownika. W Screaming Frog filtruję Response Codes po statusie 404 i eksportuję pełną listę. Przy każdym adresie sprawdzam czy strona miała ruch organiczny lub backlinki. Jeśli tak to ustawiam przekierowanie 301 na najbliższy tematycznie odpowiednik. Jeśli nie to zostawiam 404 i usuwam wewnętrzne linki prowadzące do tego adresu. Łańcuchy przekierowań to osobny problem. Sytuacja gdzie A przekierowuje na B a B na C spowalnia ładowanie i rozmywa moc linkową. Każdy łańcuch skracam do jednego przekierowania bezpośrednio na docelowy URL. Dane strukturalne weryfikuję w Google Rich Results Test. Sprawdzam czy wdrożone schematy Article, FAQ, HowTo, BreadcrumbList i Product nie zawierają błędów walidacji. Poprawne dane strukturalne nie podnoszą pozycji bezpośrednio ale zwiększają CTR w wynikach wyszukiwania o 15-30% dzięki rozszerzonym snippetom.

Ile kosztuje profesjonalny audyt SEO i jak często go przeprowadzać?

Koszt profesjonalnego audytu SEO w Polsce w 2026 roku waha się od 1 500 do 15 000 zł netto. Rozpiętość jest duża bo zależy od trzech czynników: wielkości serwisu, zakresu analizy i doświadczenia specjalisty. Audyt strony wizytówkowej na 20 podstron to 2-3 dni pracy. Audyt sklepu internetowego z 5000 produktów to 2-3 tygodnie i dokument liczący 60-80 stron. Darmowy audyt SEO oferowany przez agencje to zazwyczaj automatyczny raport z narzędzia który sprawdza podstawy techniczne bez kontekstu biznesowego. Traktuję go jako punkt wyjścia do rozmowy a nie jako dokument na którym można oprzeć strategię. Pełny kompleksowy audyt SEO zalecam przeprowadzać raz w roku. Mniejsze przeglądy techniczne w Google Search Console i monitoring wydajności robię co kwartał. Dodatkowy audyt jest konieczny po każdej dużej aktualizacji algorytmu Google, po migracji domeny lub redesignie witryny i po zauważalnym spadku ruchu organicznego. Z mojego doświadczenia firmy które audytują stronę regularnie reagują na problemy 3-4 miesiące szybciej niż te które robią to raz na 2-3 lata. Przy kosztach pozycjonowania strony sięgających kilku tysięcy miesięcznie audyt za 3000 zł zwraca się po pierwszym wdrożeniu krytycznych poprawek.

Co zrobić z wynikami audytu? Plan wdrożenia krok po kroku

Sam dokument audytu nie zmienia niczego. Wartość pojawia się dopiero w momencie wdrożenia i tu większość firm się zatrzymuje. Dostaję 80-stronicowy raport i nie wiedzą od czego zacząć. Dlatego każdy audyt kończę arkuszem z priorytetyzacją zadań podzielonym na trzy kategorie: krytyczne, ważne i do poprawy. Krytyczne to błędy które aktywnie blokują widoczność: zablokowana indeksacja, masowe duplikaty, niedziałające przekierowania. Ważne to elementy wpływające na pozycje: brakujące meta tagi, wolne ładowanie, thin content. Do poprawy to optymalizacje które dają przewagę nad konkurencją: dane strukturalne, rozbudowa treści, nowe podstrony na frazy z content gap.

Jak wdrożyć wyniki audytu SEO krok po kroku:

- Wyeksportuj wszystkie rekomendacje z audytu do jednego arkusza. Każdemu zadaniu przypisz priorytet: krytyczny, ważny lub niski.

- Zacznij wyłącznie od zadań krytycznych. Napraw błędy indeksacji, usuń duplikaty i zabezpiecz stronę jeśli audyt wykazał luki bezpieczeństwa.

- Po wdrożeniu poprawek krytycznych odczekaj 2-3 tygodnie. Monitoruj indeksację w Google Search Console i ruch organiczny w Analytics.

- Przejdź do zadań ważnych: optymalizacja szybkości, uzupełnienie meta tagów, poprawa linkowania wewnętrznego i aktualizacja treści.

- Na koniec wdróż elementy przewagi konkurencyjnej: dane strukturalne, nowe podstrony zamykające content gap i rozbudowę bloga o treści targetujące frazy z długiego ogona.

- Ustaw cykliczny przegląd co 3 miesiące. Sprawdzaj postępy względem danych z dnia audytu i koryguj plan jeśli algorytm Google wprowadził zmiany.