Najważniejsze elementy techniczego SEO, które trzeba znać

W każdym audycie technicznym SEO zaczynam od tych samych obszarów, bo to one najczęściej blokują indeksowanie lub obniżają wydajność strony. Techniczne SEO obejmuje wszystko poza treścią i linkami zewnętrznymi. Indeksowalność, szybkość ładowania, architektura serwisu, adresy URL, bezpieczeństwo witryny i dane strukturalne to elementy technicznego SEO, które sprawdzam w pierwszej kolejności. Każdy z nich wpływa na to, jak roboty indeksujące widzą stronę i jak szybko użytkownik otrzymuje odpowiedź. Pominięcie jednego potrafi zablokować efekty pozostałych. Poniższa lista porządkuje zakres technicznego SEO tak, jak realizuję go w praktyce przy audycie strony internetowej.

Lista najważniejszych elementów optymalizacji SEO:

- Indeksowalność, plik robots.txt i mapa strony XML

- Struktura URL, linkowanie wewnętrzne i nawigacja

- Szybkość ładowania strony i Core Web Vitals

- Responsywność mobilna

- Certyfikat SSL i bezpieczeństwo witryny

- Dane strukturalne Schema.org

- Tag kanoniczny i duplikacja treści

- Przekierowania 301, błędy 404 i crawl budget

- Atrybut hreflang i kierowanie międzynarodowe

- Meta tagi, kompresja kodu i optymalizacja obrazów

Indeksowalność, adresy URL i plik robots.txt jako fundament optymalizacji technicznej strony

Podczas analizy technicznej zaczynam od sprawdzenia, czy roboty indeksujące potrafią dotrzeć do kluczowych podstron i czy indeksowalność nie jest ograniczona przez przypadkowe wykluczenia. Często spotykam się z sytuacją, w której adresy URL są zbyt rozbudowane lub powielone, co utrudnia algorytmom ocenę wartości strony. Przyjazne adresy URL powinny zawierać słowo kluczowe, nie przekraczać 3 poziomów zagnieżdżenia i nie generować parametrów sesyjnych. Plik robots.txt traktuję wyłącznie jako narzędzie do zarządzania crawl budget, a nie do ukrywania treści. Jedna źle ustawiona reguła Disallow potrafi zablokować indeksowanie całego katalogu. Dlatego po każdej zmianie weryfikuję plik w Google Search Console, sprawdzając czy ważne zasoby nie zostały wykluczone. Taki zestaw kontroli pozwala w kilka minut określić, czy struktura strony internetowej daje realną szansę na stabilne indeksowanie.

Mapa strony XML, tag kanoniczny i zarządzanie duplikacją treści

W pracy nad większymi serwisami bardzo szybko widać, że mapa strony XML pełni rolę przewodnika ułatwiającego robotom odnalezienie aktualnych podstron. Sam plik nie gwarantuje indeksacji, ale przyspiesza odkrywanie nowych treści i zmian w istniejących adresach URL. Dopiero w połączeniu z prawidłowo ustawionymi tagami kanonicznymi tworzy spójny system kontroli nad duplikacją treści. W wielu projektach to błędne rel=canonical powoduje niezrozumiałe wahania widoczności strony, bo algorytm nie potrafi wybrać właściwej wersji. Szczególnie dotyczy to sklepów z filtrami produktowymi i stronami paginacji. Po uporządkowaniu duplikatów i jednoznacznym wskazaniu, które adresy są najważniejsze, widzę efekt w postaci szybszej aktualizacji indeksu. Regularnie aktualizuję mapę strony po każdej istotnej zmianie w serwisie.

Jak szybkość ładowania strony i Core Web Vitals wpływa na pozycjonowanie strony?

Szybkość ładowania strony staje się jednym z czynników, które potrafią zdecydować o przewadze nad konkurencją przy zbliżonej jakości treści. Core Web Vitals to trzy metryki opisujące realne doświadczenie użytkownika. Largest Contentful Paint mierzy czas renderowania największego elementu widocznego na ekranie. Interaction to Next Paint (INP, który zastąpił First Input Delay w marcu 2024) ocenia responsywność strony na działania użytkownika. Cumulative Layout Shift wykrywa przesunięcia layoutu podczas ładowania witryny. Gdy te parametry wypadają słabo, strona traci przewagę, ponieważ Google uznaje ją za mniej przyjazną. W praktyce widzę, że poprawa LCP o jedną sekundę potrafi przełożyć się na spadek współczynnika odrzuceń o kilkanaście procent. Wydajność strony mierzę regularnie w Google Search Console w raporcie Podstawowe wskaźniki internetowe.

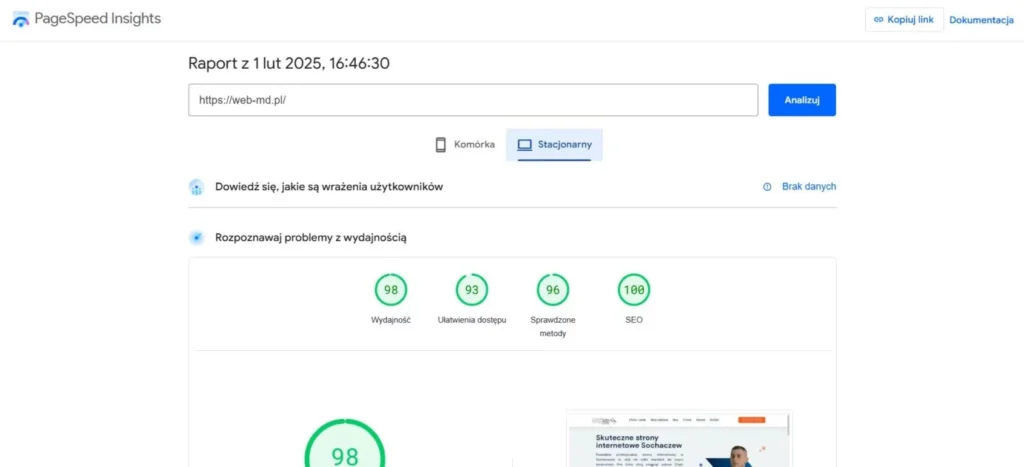

PageSpeed Insights, kompresja kodu, kompresja obrazów i lazy loading

Analizę wydajności witryny zaczynam od wyników PageSpeed Insights, bo narzędzie wskazuje konkretne elementy spowalniające ładowanie. Najczęściej problemem jest niezminifikowany CSS i JavaScript. Kompresja kodu przez usunięcie białych znaków i komentarzy zmniejsza rozmiar plików o 20 do 40 procent. Równie dużo zyskuję na kompresji obrazów, konwertując pliki PNG i JPG do formatu WebP lub AVIF. Zdjęcie o wadze 800 kB spada wtedy do 120 kB bez widocznej utraty jakości. Lazy loading stosuję do wszystkich obrazów i filmów poniżej pierwszego ekranu. Dzięki temu przeglądarka pobiera zasoby dopiero gdy użytkownik do nich przewija. Te trzy działania razem potrafią skrócić czas ładowania strony o połowę. Szczegółowe metody optymalizacji dla WordPressa opisuję w przewodniku o przyspieszaniu stron WordPress.

Responsywność mobilna i wersja strony na urządzeniach mobilnych

Google od kilku lat stosuje mobile-first indexing, co oznacza, że to wersja mobilna strony jest bazą do oceny i indeksowania. Optymalizacja mobilna nie polega tylko na tym, żeby strona się wyświetlała na telefonie. Sprawdzam, czy przyciski mają minimum 48 pikseli obszaru klikalnego, czy tekst nie wymaga powiększania i czy elementy nie nachodzą na siebie przy szerokości 360 pikseli. Responsywność mobilna wpływa bezpośrednio na interaktywność strony i czas spędzony przez użytkownika w serwisie. Serwisy bez poprawnej wersji mobilnej tracą pozycje niezależnie od jakości treści na desktopie. Problemy z wyświetlaniem na urządzeniach mobilnych diagnozuję w raporcie Obsługa na urządzeniach mobilnych w Google Search Console. Tam widzę, które podstrony generują błędy i co dokładnie wymaga poprawy w responsywnej wersji strony.

Dane strukturalne Schema.org i rich snippets – jak je wdrożyć?

Dane strukturalne Schema.org to znaczniki dodawane do kodu HTML, które pomagają wyszukiwarkom zrozumieć kontekst treści na stronie. Bez nich Google interpretuje zawartość wyłącznie na podstawie tekstu. Po wdrożeniu schema widzę w wynikach wyszukiwania rozszerzone fragmenty z ocenami, cenami, FAQ lub instrukcjami krok po kroku. Te rich snippets zwiększają CTR nawet o 30 procent przy tej samej pozycji w rankingu. Implementuję schema w formacie JSON-LD, bo Google go rekomenduje i nie wymaga on ingerencji w strukturę HTML dokumentu. Poprawność oznaczam zawsze testem w narzędziu Rich Results Test przed publikacją. Poniżej opisuję typy schema, które wdrażam najczęściej i które dają realne efekty w wynikach Google.

- Article i BlogPosting dla wpisów blogowych i artykułów

- LocalBusiness dla firm z fizyczną lokalizacją

- FAQ Page dla sekcji pytań i odpowiedzi

- Product i Offer dla stron produktowych w sklepach

- HowTo dla instrukcji i poradników krok po kroku

- Breadcrumb dla nawigacji okruszkowej

- Organization dla danych firmy na stronie głównej

Linkowanie wewnętrzne, struktura nawigacji i hierarchia URL

Linkowanie wewnętrzne to sposób, w jaki przekazuję wartość SEO między podstronami i kieruję roboty indeksujące do najważniejszych treści. Każdy link wewnętrzny z trafnym anchorem mówi algorytmowi, o czym jest strona docelowa. Stosuję zasadę, że do każdej podstrony użytkownik powinien dotrzeć w maksymalnie trzech kliknięciach od strony głównej. Hierarchia URL odzwierciedla tę strukturę: domena.pl/kategoria/podstrona zamiast wielopoziomowych ścieżek z parametrami. Optymalizacja struktury nawigacji oznacza też porządek w menu strony internetowej, gdzie każdy element odpowiada jednemu klastrowi tematycznemu. W praktyce po przebudowie linkowania wewnętrznego na serwisie z 200 podstronami widziałem wzrost zaindeksowanych stron o 40 procent w ciągu dwóch tygodni. Breadcrumbs traktuję jako obowiązkowy element nawigacji, bo jednocześnie wspierają użytkownika i dostarczają Google dodatkowy sygnał o hierarchii URL serwisu.

Certyfikat SSL, przekierowania 301 i obsługa błędów 404 oraz 5xx

Certyfikat SSL traktuję jako absolutne minimum bezpieczeństwa witryny. Strona bez HTTPS wyświetla ostrzeżenie w przeglądarce i traci zaufanie użytkowników, zanim zdążą zobaczyć treść. Google potwierdza, że protokół HTTPS jest sygnałem rankingowym, więc brak certyfikatu oznacza oddawanie pozycji konkurencji. Przekierowanie 301 stosuję przy każdej zmianie adresu URL, żeby zachować dotychczasową wartość SEO i nie generować błędów indeksowania. Unikam łańcuchów przekierowań dłuższych niż dwa skoki, bo każdy kolejny spowalnia ładowanie witryny i marnuje crawl budget. Błędy 404 sprawdzam cyklicznie w Google Search Console i naprawiam te, które dotyczą stron z ruchem lub linkami przychodzącymi. Błędy 5xx to problem po stronie serwera i wymagają natychmiastowej reakcji, bo powtarzające się awarie powodują wypadnięcie podstron z indeksu. Regularny monitoring stron internetowych pozwala wychwycić te problemy techniczne zanim wpłyną na widoczność strony.

Crawl budget, paginacja i optymalizacja stron z filtrami

Crawl budget to limit zasobów, które Googlebot przeznacza na crawlowanie danej witryny w określonym czasie. Na małych stronach do 500 podstron rzadko stanowi problem. Przy serwisach e-commerce z tysiącami produktów i filtrami staje się czynnikiem decydującym o tym, które strony zostaną zaindeksowane. Każda kombinacja filtrów w sklepie generuje nowy adres URL. Bez kontroli setki bezwartościowych podstron pochłaniają budżet przeznaczony na ważne strony produktowe i kategorie. Filtry blokuję przez noindex lub parametry w Google Search Console, zostawiając do indeksowania tylko te kombinacje, które odpowiadają realnym zapytaniom użytkowników. Paginację obsługuję przez self-referencing canonical na każdej stronie wynikowej, bo Google nie wspiera już rel=next i rel=prev jako sygnału indeksowania. W sklepach na WooCommerce kontroluję te elementy na poziomie ustawień wtyczek WordPress, co pozwala ograniczyć marnowanie crawl budget bez ręcznej edycji kodu.

Atrybut hreflang i kierowanie międzynarodowe

Atrybut hreflang wskazuje wyszukiwarkom, która wersja językowa strony powinna wyświetlić się użytkownikowi na podstawie jego lokalizacji i języka przeglądarki. Bez niego Google sam decyduje, którą wersję pokazać, co często kończy się kanibalizacją między wersjami pl, en i de tego samego serwisu. Kierowanie międzynarodowe wymaga spójności, więc hreflang implementuję zawsze dwukierunkowo. Strona polska musi wskazywać na angielską i odwrotnie. Brak wzajemnego potwierdzenia powoduje, że Google ignoruje całą deklarację. Hreflang umieszczam w sekcji head dokumentu HTML lub w mapie strony XML, gdy serwis ma więcej niż pięć wersji językowych. Błędy w implementacji hreflang diagnozuję w Google Search Console w raporcie Kierowanie międzynarodowe. Najczęstszy problem to brakujący tag x-default, który powinien wskazywać domyślną wersję strony dla użytkowników spoza zdefiniowanych regionów.

Audyt techniczny SEO – narzędzia i proces

Audyt techniczny SEO przeprowadzam w stałej kolejności: najpierw stan indeksacji w Google Search Console, potem pełny crawl w Screaming Frog, na końcu wydajność strony w PageSpeed Insights. Te trzy narzędzia SEO wystarczają, żeby zidentyfikować 90 procent problemów technicznych. Screaming Frog wykrywa błędy 404, łańcuchy przekierowań, brakujące meta tagi i duplikację treści w jednym skanie. GTmetrix i Ahrefs Site Audit uzupełniam przy większych serwisach, gdy potrzebuję głębszej analizy technicznego SEO. Cały proces opisuję krok po kroku w osobnym artykule o tym, jak przeprowadzić audyt strony internetowej.

Google Search Console, Screaming Frog i PageSpeed Insights w praktyce

Google Search Console odpala w każdym projekcie jako pierwsze narzędzie. Raport Strony w sekcji Indeksowanie pokazuje mi, ile podstron Google zna, ile zaindeksował i dlaczego odrzucił resztę. Błędy indeksowania typu Znaleziono, ale obecnie nie zaindeksowano często sygnalizują problemy z jakością lub duplikacją treści. Screaming Frog uruchamiam lokalnie i skanuję cały serwis do 500 adresów URL w darmowej wersji. Narzędzie wykrywa brakujące meta title, meta description dłuższe niż 160 znaków, obrazy bez atrybutu alt i wewnętrzne linki prowadzące do błędów 404. PageSpeed Insights dostarcza wyniki Core Web Vitals dla konkretnych podstron zarówno z danych laboratoryjnych, jak i od realnych użytkowników Chrome. Dane z sekcji Dane z pola traktuję jako miarodajne, bo odzwierciedlają faktyczną wydajność strony. Więcej darmowych narzędzi SEO przydatnych w codziennej pracy opisuję w osobnym zestawieniu.

Jakie są największe błędy techniczne i jak je naprawić?

Po kilkuset audytach widzę, że te same problemy techniczne powtarzają się niezależnie od branży i rozmiaru serwisu. Większość z nich blokuje indeksowanie ważnych stron lub obniża wydajność strony na tyle, żeby wpłynąć na pozycje w Google. Poniżej zbieram najczęstsze błędy techniczne, które spotykam w praktyce, wraz ze sposobem ich naprawy.

- Zablokowanie kluczowych podstron w pliku robots.txt. Naprawiam przez przegląd reguł Disallow i test w Google Search Console.

- Brak mapy strony XML lub nieaktualna mapa z nieistniejącymi adresami URL. Generuję nową i zgłaszam w GSC.

- Łańcuchy przekierowań 301 z trzema lub więcej skokami. Skracam do jednego przekierowania bezpośrednio na adres docelowy.

- Duplikacja treści bez tagu kanonicznego. Ustawiam rel=canonical wskazujący na wersję główną.

- Brak certyfikatu SSL lub mieszana zawartość HTTP i HTTPS. Wymuszam HTTPS na poziomie serwera i poprawiam wszystkie zasoby wewnętrzne.

- Obrazy bez kompresji i formatu nowej generacji. Konwertuję do WebP i wdrażam lazy loading.

- Brakujące lub zduplikowane meta title i meta description. Uzupełniam unikalne tagi dla każdej podstrony.

- Błędy 404 na stronach z linkami przychodzącymi. Ustawiam przekierowanie 301 na najbliższy tematycznie adres URL.

- Nieoptymalny crawl budget przez indeksowanie stron filtrów i paginacji. Blokuję noindex lub przez parametry w GSC.

- Słabe wyniki Core Web Vitals spowodowane blokującym renderowanie JavaScriptem. Opóźniam ładowanie skryptów przez atrybuty defer i async.

Techniczne SEO a pozycjonowanie – dlaczego optymalizacja techniczna decyduje o wynikach?

Techniczne SEO a pozycjonowanie stron www to nie dwa osobne procesy, tylko zależność przyczynowo skutkowa. Bez poprawnej optymalizacji technicznej strony nawet najlepszy content i silny profil linków nie przełożą się na stabilne pozycje. Widziałem serwisy z setkami wartościowych artykułów, które traciły widoczność strony przez jedno błędne przekierowanie blokujące indeksowanie całej kategorii. Google najpierw musi znaleźć stronę, zrozumieć jej strukturę i ocenić wydajność. Dopiero potem analizuje treść i linki. Dlatego znaczenie technicznego SEO rośnie z każdą aktualizacją algorytmu, a czynniki rankingowe Google coraz mocniej uwzględniają szybkość ładowania, stabilność wizualną i responsywność mobilną. Elementy optymalizacji technicznej traktuję jako fundament, bez którego pozostałe działania SEO pracują na ułamku swojego potencjału. Uporządkowanie techniczne serwisu to pierwszy krok, który robię przed pisaniem treści i budowaniem linków.