Techniczne SEO – najważniejsze elementy, które trzeba znać

W pracy z serwisami najczęściej widzę, że techniczne SEO wpływa na kilku obszarach, które decydują o tym, czy strona będzie prawidłowo interpretowana przez roboty i czy użytkownik dostanie szybko działającą witrynę. Dobrym sposobem na uporządkowanie tych elementów jest potraktowanie ich jako zestawu procesów obejmujących indeksowanie, wydajność, strukturę strony oraz kontrolę nad danymi, które przekazuje strona. Taki podział pozwala od razu określić, gdzie leżą problemy i które działania przyniosą najszybszy efekt.

Zakres technicznego SEO – obszary najważniejsze

| Obszar | Co oceniam |

|---|---|

| Indeksowalność | sposób, w jaki roboty przechodzą przez stronę i zapisują ją w indeksie |

| Adresy URL | logika struktury strony, duplikaty, parametry i kierunki przepływu |

| Wydajność | czas ładowania strony, Core Web Vitals, stabilność renderowania |

| Architektura | hierarchia URL stron, nawigacja, linkowanie wewnętrzne, meta title |

| Dane strukturalne | poprawność schema i możliwość rozszerzonych wyników |

| Bezpieczeństwo | SSL, protokoły i poprawność komunikacji |

| Kontrola błędów | Błędy 404, błędy indeksowania, problemy serwerowe |

Indeksowalność, adresy URL i plik robots.txt jako fundament optymalizacji technicznej strony

Podczas analizy technicznej zaczynam od sprawdzenia, czy roboty wyszukiwarki potrafią dotrzeć do kluczowych podstron. Dodatkowo sprawdzam czy indeksowalność nie jest ograniczona przez przypadkowe wykluczenia. Często spotykam się z sytuacją, w której adresy URL są zbyt rozbudowane lub powielone, co utrudnia algorytmom ocenę wartości strony. Plik robots.txt traktuję wyłącznie jako narzędzie do zarządzania poruszaniem się robotów, a nie do ukrywania treści, więc zawsze weryfikuję, czy nie blokuje ważnych zasobów. Taki zestaw podstawowych kontroli pozwala w kilka minut określić, czy strona ma realną szansę na stabilne indeksowanie.

Mapa strony XML, Tag kanoniczny i zarządzanie duplikacją treści

W pracy nad większymi serwisami bardzo szybko widać, że mapa strony XML pełni rolę przewodnika, który ułatwia robotom odnalezienie aktualnych podstron. Jednak dopiero w połączeniu z prawidłowo ustawionymi adresami kanonicznymi tworzy spójny system kontroli nad duplikacją treści. W wielu projektach to właśnie błędne tagi kanoniczne powodują niezrozumiałe wahania widoczności, bo algorytm nie potrafi wybrać właściwej wersji strony. Dopiero po uporządkowaniu duplikatów i jednoznacznym wskazaniu, które adresy są najważniejsze, widać efekt w postaci szybszej aktualizacji indeksu i stabilniejszej pozycji.

Jak szybkość ładowania strony i Core Web Vitals wpływa na pozycjonowanie strony?

W praktyce widzę, że szybkość ładowania strony staje się jednym z czynników, które potrafią zdecydować o tym, jak algorytm traktuje serwis podczas oceny jakości. Core Web Vitals działa tutaj jak zestaw mierników opisujących realne doświadczenie użytkownika, dlatego ocena Largest Contentful Paint, First Input Delay i Cumulative Layout Shift przekłada się bezpośrednio na ocenę użyteczności. Gdy parametry te wypadają słabo, strona traci przewagę konkurencyjną, ponieważ roboty uznają ją za mniej wydajną i mniej przyjazną. W pozycjonowaniu strony liczy się każdy element wpływający na komfort korzystania z witryny, a ładowanie witryny obciążone błędami technicznymi potrafi skutecznie obniżyć ruch organiczny.

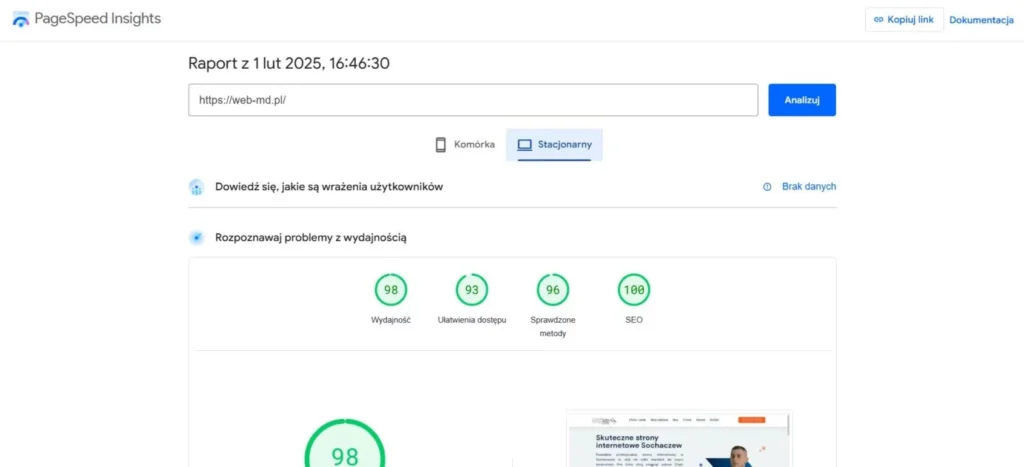

PageSpeed Insights, kompresja kodu, kompresja obrazów i lazy loading

W analizie wydajności witryny zawsze zaczynam od wyników PageSpeed Insights, bo pokazują, w którym obszarze strona traci najwięcej czasu. Narzędzie pomaga określić, czy winny jest kod, obrazy, blokujące skrypty lub niewłaściwe ładowanie zasobów. Kompresja kodu często rozwiązuje problem nadmiarowych plików i zmniejsza koszt przesyłania danych, natomiast kompresja obrazów potrafi skrócić czas ładowania strony nawet o kilka sekund. Lazy loading traktuję jako sposób na ograniczenie pobierania zasobów, których użytkownik jeszcze nie widzi, dzięki czemu strona daje wrażenie szybszej i bardziej responsywnej. Zestaw tych działań pozwala znacząco poprawić Core Web Vitals i zbudować stabilniejszą widoczność.

Wydajność strony a ładowanie witryny na urządzeniach mobilnych

W pracy z stronami mobilnymi szybko zauważam, że wydajność strony na telefonach różni się od tego, co widzimy na desktopie. Urządzenia mobilne mają mniejszą moc obliczeniową i działają w zmiennych warunkach sieciowych, dlatego nawet niewielkie błędy w optymalizacji mobilnej potrafią wydłużyć czas ładowania strony. Właśnie dlatego optymalizacja mobilna stała się jednym z podstawowych elementów technicznego SEO. Gdy strona nie spełnia wymagań użytkowników mobilnych, rośnie współczynnik odrzuceń, a algorytm interpretuje to jako sygnał, że serwis nie dostarcza wartości. Dopiero po dopracowaniu wydajności i eliminacji zbędnych skryptów widać poprawę w zakresie indeksowania i ruchu z wyników mobilnych.

Optymalizacja mobilna i doświadczenie użytkownika (UX)

W pracy z projektami mobilnymi często widzę, że optymalizacja mobilna wpływa na odbiór całej witryny szybciej niż jakikolwiek inny element technicznego SEO. Użytkownik podejmuje decyzję w ciągu kilku sekund, dlatego sposób optymalizacji treści, stabilność układu i czas reakcji mają znaczenie już przy pierwszym kontakcie. UX zależy tutaj nie tylko od wyglądu strony, ale również od sposobu, w jaki przeglądarka pobiera i interpretuje zasoby. Gdy proces ten przebiega bez opóźnień, rośnie liczba interakcji i maleje ryzyko opuszczenia strony, co przekłada się na lepszy wynik w rankingach mobilnych.

Responsywność mobilna, interaktywność strony i struktura URL

Responsywność strony oceniam jako punkt startowy, bo to ona decyduje o tym, czy treść dopasowuje się do ekranu bez konieczności przewijania w poziomie lub powiększania elementów. Interaktywność strony pokazuje z kolei, jak szybko użytkownik może wejść w reakcję z pierwszym widocznym elementem, a każde opóźnienie wpływa na ocenę Core Web Vitals. Struktura URL również ma znaczenie, ponieważ czytelne i spójne adresy pomagają użytkownikowi poruszać się po serwisie i ułatwiają algorytmom interpretację hierarchii treści. Takie połączenie daje efekt w postaci strony, która zachowuje się przewidywalnie i nie traci energii użytkownika na zbędne operacje.

Jak poprawić doświadczenie użytkownika poprzez elementy technicznego SEO?

Kiedy chcę poprawić doświadczenie użytkownika, zaczynam od sprawdzenia, czy strona daje szybki dostęp do treści i czy nie traci czasu na pobieranie zasobów, które nie są potrzebne przy pierwszym widoku. Dopiero później przechodzę do analizy elementów odpowiedzialnych za stabilność układu, a więc do optymalizacji obrazów, redukcji skryptów i kontroli nad procesem ładowania. W wielu przypadkach już samo uporządkowanie kolejek zasobów zmienia sposób, w jaki użytkownik postrzega stronę, ponieważ interakcja staje się bardziej naturalna i przewidywalna. To połączenie techniki i UX pokazuje, że dobrze wykonane techniczne SEO jest odczuwalne nie tylko przez roboty, ale przede wszystkim przez realnych odwiedzających.

Czym są dane strukturalne i bezpieczeństwo witryny?

W codziennej pracy widzę, że dane strukturalne i bezpieczeństwo witryny wpływają na sposób, w jaki wyszukiwarka interpretuje stronę oraz na to, czy użytkownik czuje się na niej pewnie. Dane strukturalne porządkują informacje tak, aby algorytm mógł szybciej zrozumieć kontekst treści, a zabezpieczenia techniczne chronią komunikację między przeglądarką a serwerem. Taki zestaw działa jako podwójna warstwa, gdzie jedna wzmacnia widoczność w wynikach, a druga utrzymuje stabilność i zaufanie, które są dziś równie istotne jak sama wartość merytoryczna. Treść musi być spójna i zrozumiała, dlatego w wielu projektach kieruję klientów do poradnika o pisaniu treści SEO, bo dopiero połączenie dobrej jakości tekstu z optymalizacją techniczną daje przewidywalny i trwały efekt.

Schema.org, Rich Snippets i ich wpływ na widoczność strony

Korzystam z oznaczeń Schema.org wtedy, gdy chcę, aby strona została poprawnie zinterpretowana i miała szansę pojawić się w formie rozszerzonego wyniku. Ten mechanizm pozwala algorytmom odczytać relacje między elementami strony i dopasować je do odpowiedniego typu zapytania. Rich Snippets działają tutaj jak efekt końcowy, czyli wizualne wyróżnienie treści w wynikach wyszukiwania. W wielu projektach wprowadzenie oznaczeń pod produkty, artykuły lub wydarzenia powodowało zauważalny wzrost kliknięć, ponieważ strona stawała się bardziej czytelna dla użytkownika i atrakcyjniejsza na liście wyników. Właśnie dlatego traktuję dane strukturalne jako element podnoszący jakość technicznego SEO, a nie jako dodatek.

Certyfikat SSL i inne elementy bezpieczeństwa technicznego

Przy ocenie bezpieczeństwa strony internetowej zaczynam od sprawdzenia, czy strona działa w pełni na protokole HTTPS oraz czy certyfikat SSL jest prawidłowo wdrożony. Ten element wpływa nie tylko na sposób przesyłania danych, ale także na decyzję algorytmu, który preferuje witryny działające w bezpiecznym środowisku. Dopiero po tej kontroli przechodzę do analizy nagłówków bezpieczeństwa, konfiguracji serwera i potencjalnych luk, które mogą wpłynąć na stabilność. Właśnie te techniczne aspekty budują fundament zaufania użytkownika i pomagają utrzymać stronę w dobrej kondycji podczas indeksowania.

Audyt techniczny SEO i darmowe narzędzia seo do analizy

W czasie audytu technicznego SEO koncentruję się na elementach, które decydują o indeksowaniu, wydajności i stabilności serwisu, dlatego korzystam głównie z narzędzi umożliwiających szybkie wykrywanie błędów i ocenę kondycji strony. Darmowe narzędzia SEO pomagają zbudować pierwszy obraz sytuacji i wskazują miejsca, w których strona traci potencjał. Taki audyt pozwala zrozumieć, jak roboty przechodzą przez strukturę strony, które zasoby blokują ładowanie i gdzie pojawiają się problemy wpływające na widoczność. Dopiero po takiej analizie technicznego SEO można precyzyjnie zaplanować działania techniczne.

Google Search Console, Screaming Frog i inne kluczowe narzędzia SEO

W pracy najczęściej sięgam po Google Search Console, ponieważ daje bezpośredni wgląd w to, jak wyszukiwarka postrzega stronę i które adresy są faktycznie indeksowane. Narzędzie pokazuje błędy, problemy z wydajnością witryny oraz ostrzeżenia dotyczące danych strukturalnych, co pozwala szybko ocenić ogólny stan techniczny. Do skanowania serwisu wykorzystuję także Screaming Frog, bo potrafi przejść przez całą stronę podobnie jak robot i wychwycić duplikaty, błędne przekierowania oraz problemy z adresami URL. W zależności od projektu korzystam również z narzędzi analizujących nagłówki serwera, pliki zasobów i wydajność witryny, aby uzyskać pełen obraz tego, jak funkcjonuje cała witryna.

Jak wykrywać błędy indeksowania, Błędy 404 i problemy techniczne?

Podczas analizy zaczynam od sprawdzenia, które strony zostały odrzucone podczas indeksowania i jaki jest powód tego odrzucenia, ponieważ wskazuje to na potencjalne błędy w strukturze witryny. Potem przechodzę do weryfikacji błędów 404, które często wynikają z nieudokumentowanych zmian w adresach URL lub niewłaściwego zarządzania treścią. Takie błędy potrafią przerwać przepływ robotów i obniżyć wartość linkowania wewnętrznego. W dalszej kolejności badam problemy techniczne związane z wydajnością witryny, blokowaniem zasobów lub niepoprawnym renderowaniem, ponieważ wpływają one na ocenę jakości i finalnie na widoczność strony. Dopiero po uporządkowaniu tych elementów serwis może być stabilnie indeksowany i utrzymywać stałe pozycje.